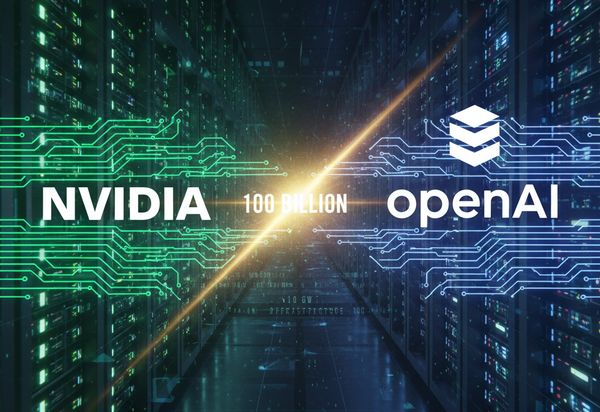

Nvidia und OpenAI schmieden eine der größten Allianzen der Tech-Geschichte: Der Grafikchip-Pionier will bis zu 100 Milliarden US-Dollar in den ChatGPT-Entwickler investieren und zugleich als bevorzugter Compute- und Netzwerkpartner eine neue Generation von KI-Rechenzentren aufbauen. Kern des Vorhabens ist eine Absichtserklärung über mindestens 10 Gigawatt Rechenkapazität auf Basis kommender Nvidia-Systeme, die OpenAIs nächste Welle von Modellen trainieren und betreiben sollen. Der Schritt verschärft den Wettbewerb um Chips, Energie und Flächen für KI-Infrastruktur und verankert Nvidia noch tiefer im Ökosystem jener Firma, die die jüngste KI-Welle maßgeblich ausgelöst hat.

Wie der Deal konstruiert ist

Finanziell ist die Vereinbarung zweigleisig angelegt: OpenAI bezahlt die bestellten Nvidia-Systeme in bar, während Nvidia im Gegenzug nicht-stimmberechtigte Anteile an OpenAI erhält. Der Einstieg soll stufenweise erfolgen; nach Abschluss einer endgültigen Liefervereinbarung wird Nvidia zunächst rund 10 Milliarden US-Dollar investieren. Damit koppeln beide Seiten den Kapitalfluss eng an den konkreten Ausbau der Infrastruktur – und reduzieren Risiken in einem Markt, der sich mit atemberaubender Geschwindigkeit entwickelt.

Zeitleiste und Technik: 10 GW, Vera Rubin und Millionen GPUs

Die erste Ausbaustufe ist für die zweite Jahreshälfte 2026 vorgesehen: Dann sollen die ersten Gigawatt Compute-Leistung auf Nvidias neuer Vera-Rubin-Plattform ausgeliefert und in Betrieb genommen werden. Insgesamt sprechen beide Unternehmen von „Millionen GPUs“, die in sogenannten KI-Fabriken zusammengefasst werden. Nvidia betont, die bis zu 100 Milliarden US-Dollar würden schrittweise „pro Gigawatt“ fließen – also entlang messbarer Meilensteine beim Aufbau der Rechenzentren. OpenAI selbst verweist auf eine wöchentlich aktive Nutzerschaft von inzwischen über 700 Millionen Menschen als Treiber für den massiven Skalierungsbedarf.

Strategische Wirkung: Microsoft, Partnernetz und Regulierung

Strategisch verschiebt der Deal Gewichte im KI-Ökosystem. Für OpenAI bedeutet er mehr Unabhängigkeit bei der Beschaffung von Rechenleistung und eine engere Verzahnung mit Nvidias Roadmap; zugleich ergänzt er bestehende Partnerschaften mit Microsoft, Oracle, SoftBank und den Stargate-Initiativen zum Aufbau global verteilter KI-Rechenzentren. Für Nvidia sichert die Beteiligung den Zugang zu einem der bedeutendsten KI-Software-Akteure und stabilisiert die Nachfrage nach High-End-Systemen über Jahre. Beobachter rechnen mit regulatorischer Prüfung, da sowohl die Kapitalverflechtung als auch die Bündelung von Chiplieferungen und Compute-Kapazitäten potenziell wettbewerbsrelevante Effekte haben. Parallel arbeitet OpenAI – wie andere Hyperscaler – weiter an eigenen Beschleunigern mit Partnern wie Broadcom und TSMC; der heutige Pakt ändert diese Pläne nicht grundsätzlich, erhöht jedoch die Handlungsspielräume bei der Kapazitätsplanung.

Marktreaktion und Einordnung

An den Börsen unterstreicht die Reaktion die Dimension: Nvidias Aktie legte nach der Ankündigung deutlich zu, was die Erwartung widerspiegelt, dass der Aufbau von 10 Gigawatt KI-Infrastruktur Milliardenumsätze für Hard- und Software nach sich zieht. Gleichzeitig verdeutlicht das Volumen den Kapitalhunger der Branche: Rechenzentren in dieser Größenordnung erfordern nicht nur Chips, sondern vor allem Strom, Netze, Kühlung und Standorte – ein Zusammenspiel, das in den kommenden Jahren über die Geschwindigkeit von KI-Fortschritten mitentscheiden wird.

Warum das wichtig ist

Die Investition markiert einen Wendepunkt: Statt punktueller GPU-Beschaffung rückt nun der industriell getaktete Aufbau von KI-Fabriken in den Mittelpunkt – mit festen Kapazitätszielen, klaren Liefermeilensteinen und einer finanziellen Architektur, die Compute wie ein Versorgungsnetz skaliert. Für Entwickler und Unternehmen könnte das sinkende Latenzen, größere Kontexte und robustere Verfügbarkeit bedeuten; für Wettbewerber erhöht es den Druck, eigene Lieferketten, Energiezugänge und Software-Stacks zu sichern. Kurz: Nvidia und OpenAI setzen einen Referenzrahmen für das KI-Zeitalter, in dem Rechenleistung zur strategischen Infrastruktur wird – vergleichbar mit Stromnetzen oder Mobilfunk in früheren Wellen der Digitalisierung.

Quellen

- NVIDIA Newsroom: Strategische Partnerschaft & Investitionsrahmen

- Reuters: Nvidia investiert bis zu 100 Mrd. US-$ in OpenAI

- The Guardian: Struktur des Deals und Zeitplan

- TechCrunch: Einordnung im Partner-Ökosystem

- heise online: Deutsche Zusammenfassung und Kontext